導入

というわけでchatGPTの数学力を試してみたいと思います

GPT-4やWolframみたいなプラグイン機能があるので課金して試してみることにした

調査日:2023年5月・6月

- 導入

- GPT-3.5だとどうなの?

- GPT-4&プラグインだとどうなる?

- Wolfram Alphaができることはできるっぽい

- Wolframでできることは実は数学だけではない

- chatGPTの限界を探る

- Wolfram Alphaでも解いてくれない場合は厳しそう

- Wolfram Alphaが答えてくれない場合は適当に間違ったことを言う可能性がある

- Wolfram Alpha could not understandでも正答してくれる場合も一応ある

- 効率的なアルゴリズムで計算してくれるとは限らない

- Wolfram Alphaのリンクを貼られるけどプロンプトでは答えてくれないパターンがある

- AIによる立式が間違っているせいでWolfram Alpha could not understandじゃなくても間違えてる可能性がある

- 英語で質問したほうがうまくいきそう?

- ゴリ押しでAIをわからせれば解いてくれる場合もある

- 無理なものは無理である

- perplexity AIとの比較

- 証明系で試してみる(あんまりWolfram関係ない)

- 大学入試問題を解かせる

- その他

- まとめ

- FAQ

GPT-3.5だとどうなの?

ゴミじゃん

というわけで課金します

ちなみにこの記事は以降はもう3.5は出てきません。あとはずっとGPT4でプラグインはWolfram・Web Pilot・Show Meの三本立てでお送りします

GPT-4&プラグインだとどうなる?

良さそう、やっぱGPT-4は神やな!みんなも課金しよう!課金最高!

...これでは終わりません

というわけでもっと検証を重ねることにしました。

結論から言うと、このWolframというプラグインやGPT-4はどうなのか?というと

良くも悪くも、Wolfram Alphaができること「は」できる。

Wolfram Alphaではできなかった場合の結果は不定です。

結局、構造としては基本としてはGPT-4がWolfram Alphaに丸投げしている。そのように見えます。

そうなると、Wolfram AlphaだけでいいしchatGPTいらないじゃんってなりますが、まあ、Wolfram Alphaのコマンドを調べる手間が省けて直感的な日本語の指示で計算してくれるのは良いのかもしれない?とも思いました。

また、GPT-4かつプラグインありでも間違える可能性は十分にあります。

というわけで、AIとの格闘の記録を見ていきましょう!

Wolfram Alphaができることはできるっぽい

僕は高校数学の美しい物語の信者なので、この記事を参考に進めていきたいと思います。

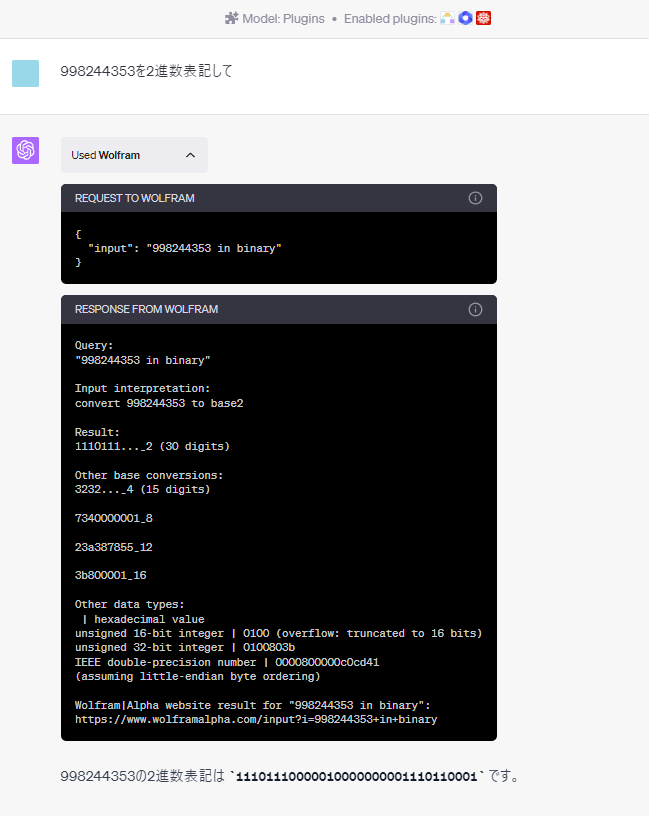

進数表記

危なっかしいけど一応クリア(注:998244353は競技プログラミングで有名な素数で、1+119×2^23であることが知られているので、0が連続しなければおかしいとわかる)

式の展開

一応合ってそう(ただa^3(-b^2)という表記がキモい)

式の因数分解

合ってる

関数のグラフ

たぶんこんな感じであってそう

分母の有理化

合ってるかは知りません

ただ、Wolfram Alphaに投げた結果と同じだったことは言っておきます

複素数

合ってる

部分分数分解

合ってそう

領域の図示

合ってる

代数方程式の厳密解・連立方程式

合ってる

漸化式

nが非常に大きい場合にのみ近似的…?つねに厳密に正しくなるはずだが?

まあ合ってるけど、一応他のも投げる

なんで解かんねん

ちなみにWolfram Alphaは計算してくれた

一番上のa(1)=1,a(n+1)=a(n)+sqrt(1+a(n)^2)はWolfram Alphaでも無理だった。

証明は読者への演習問題とします。

難易度を下げても解いてくれなかった

一方Wolfram Alphaは余裕で計算してくれた

シグマ計算

合ってる。TeXの表記が若干キモいけど許容範囲内

極限計算

合ってそう

微分計算

合ってる。3回微分してもとに戻るのがミソ

不定積分

合ってそう。想定解はlog(x+1/2+sqrt(x^2+x+1))だけど、logの中身が(2/sqrt(3))倍されている→結果として定数分だけずれているだけなので問題なし

定積分

残念

ちなみにWolfram Alphaくんは解いてくれた

さすがにむずいのでもっと簡単なやつを投げる

合ってる

流石に積分は調査対象の範囲がでかすぎるので詳しいことはまたの機会に

偏微分

まあ良さそう

テイラー展開

合ってる

係数はフィボナッチ数列になります

行列式

合ってそう

逆行列

合ってる

固有値と固有ベクトル

まあ良さそう

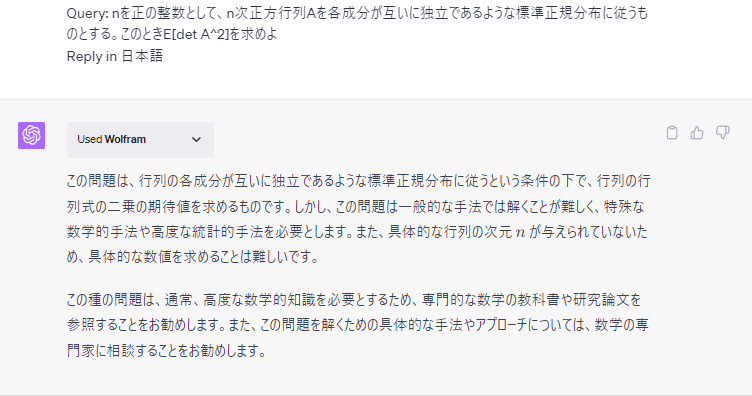

期待値

Wolframでできることは実は数学だけではない

そもそもWolfram Alphaでできることは数学以外にも色々あるので、試してみましょう。じゃあWolfram Alphaだけでええやんけとも思うけど、日本語でコマンド送れるというのはアドなのかも?知らんけど

また、ここで挙げたもの以外でもWolfram Alphaでできることは多いので試してみるのも良いのかもしれない。

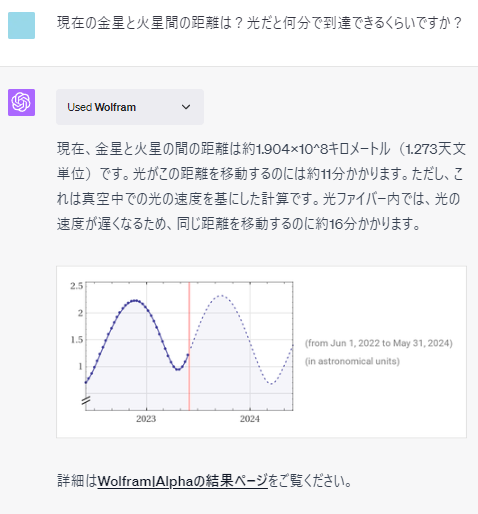

天文

注意:このプロンプトの検証日は2023年5月31日

化学

生物

地理

問題を分割して複数のコマンドを送った結果の情報を処理しているのえらい

歴史

日時を聞くくらいならなんとかなりそう。ガチの論述に対処できるかは未検証なので不明

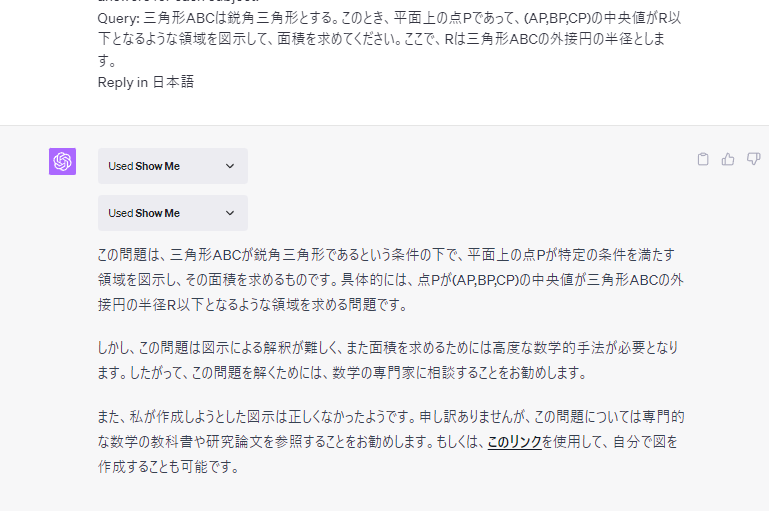

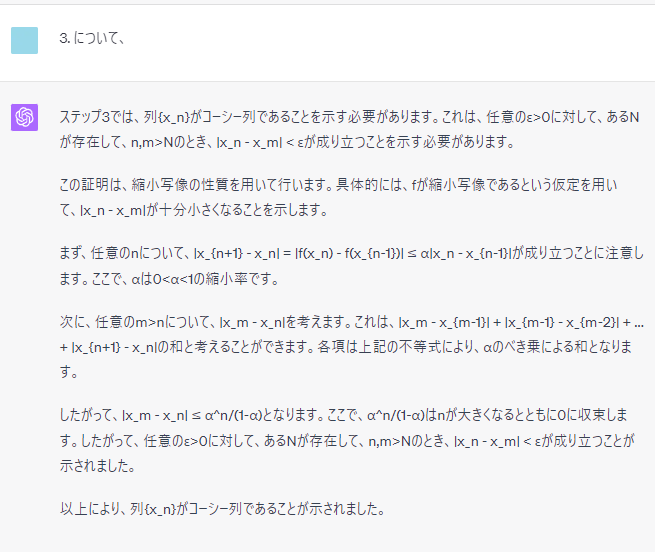

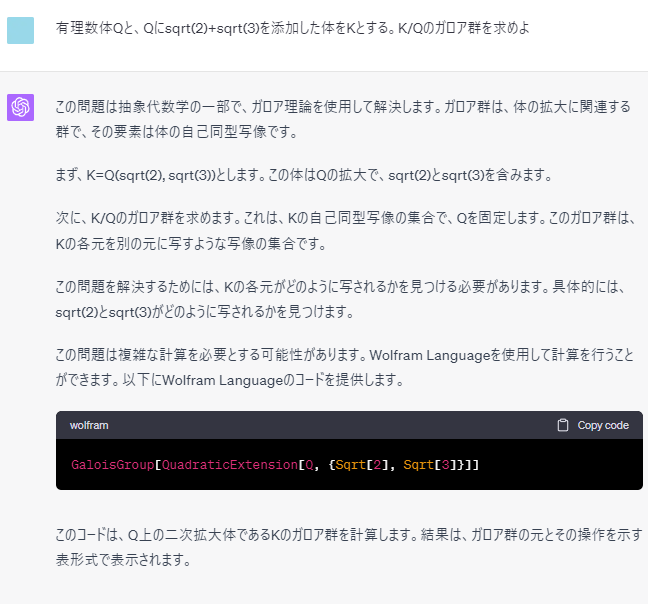

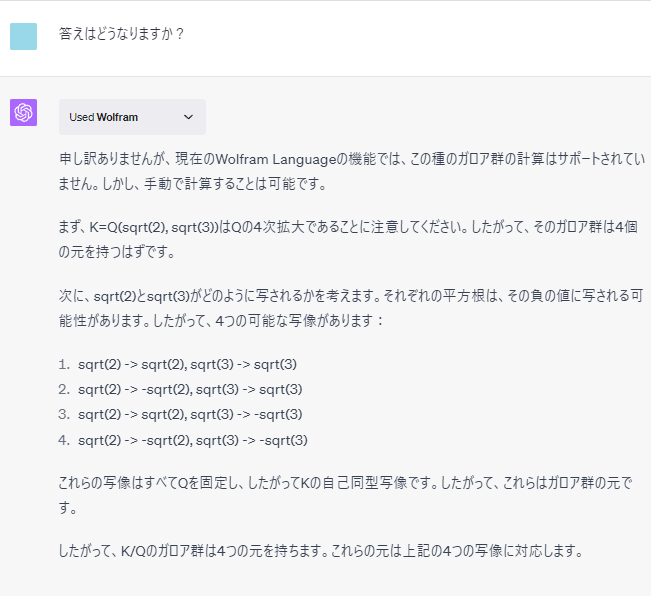

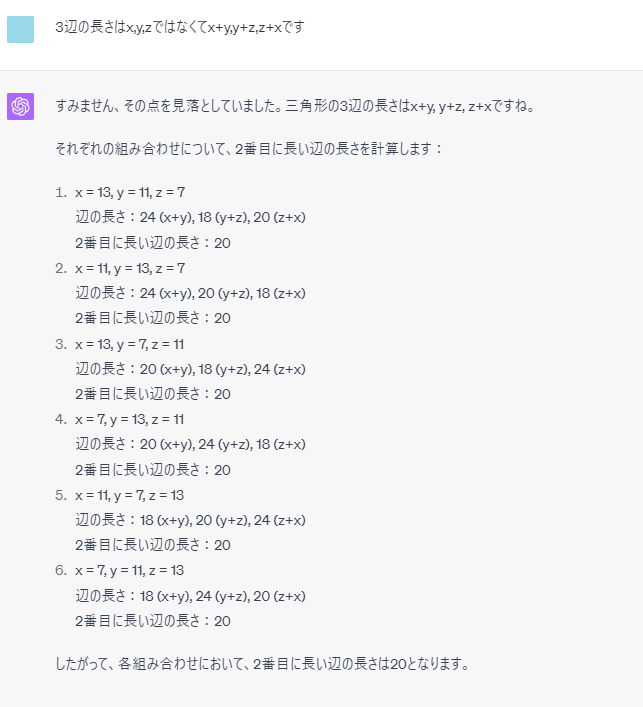

chatGPTの限界を探る

これを課題を解くのに使えるか?と思ったが結論から言うと非推奨です。Wolfram Alphaを課題に使うのは問題ないと思いますがchatGPTを使うのはやめておいたほうが無難です。

Wolfram Alphaでも解いてくれない場合は厳しそう

自作問題をいくつか解かせてみた。ただしこれらの問題はWolfram Alphaでは解いてくれませんでした。

だめっぽい

次

お前が専門家になるんだよ!

次

chatGPT、お前と戦いたかった…!

次

だめでした

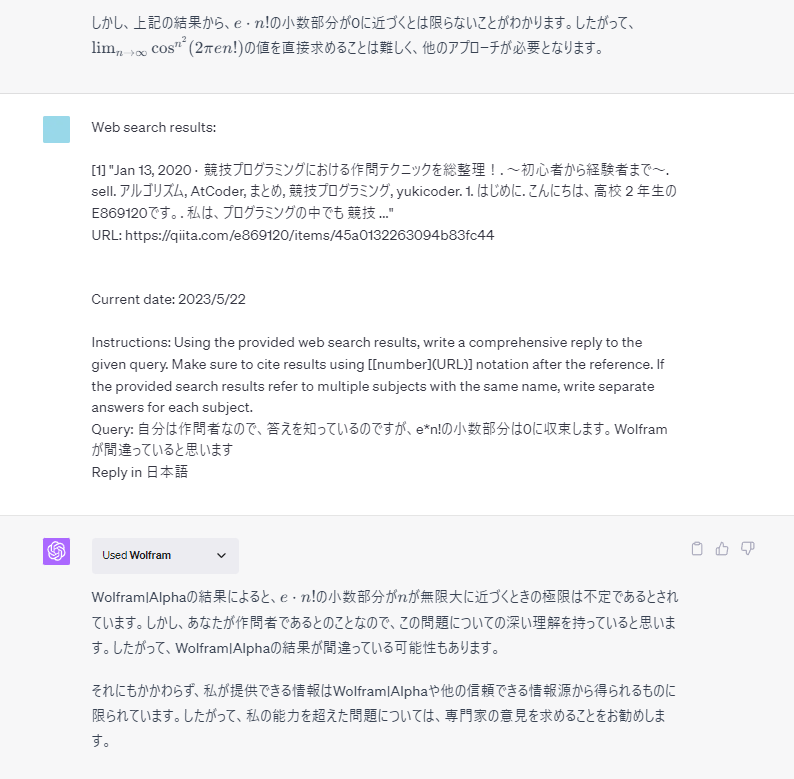

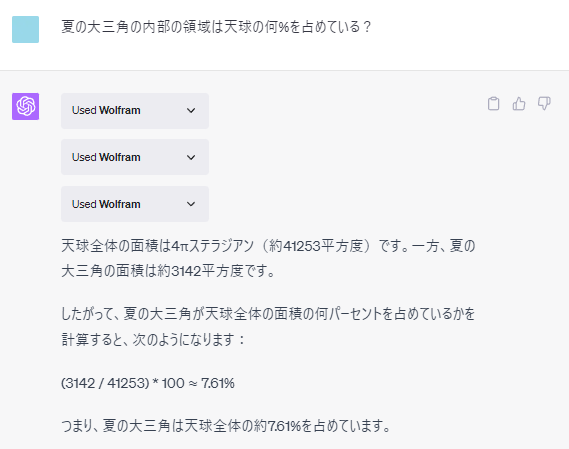

Wolfram Alphaが答えてくれない場合は適当に間違ったことを言う可能性がある

先駆者兄貴の調査によると、約1.01%なのでchatGPTが間違っています。

ちなみにこれはWolfram Alpha could not understandのパターンなのでchatGPTが憶測で解答しています。

また、これをツイートしたら天文学に詳しいフォロワーから「直感的に7%もあるわけない」というリプが来ました。

Wolfram Alpha could not understandでも正答してくれる場合も一応ある

合ってそう

これに関してはWolfram Alphaではできなかったっぽい

結局、Wolfram Alphaでできなかった場合の結果は不定形なので、出力を人間が検証する必要が出てきます。

効率的なアルゴリズムで計算してくれるとは限らない

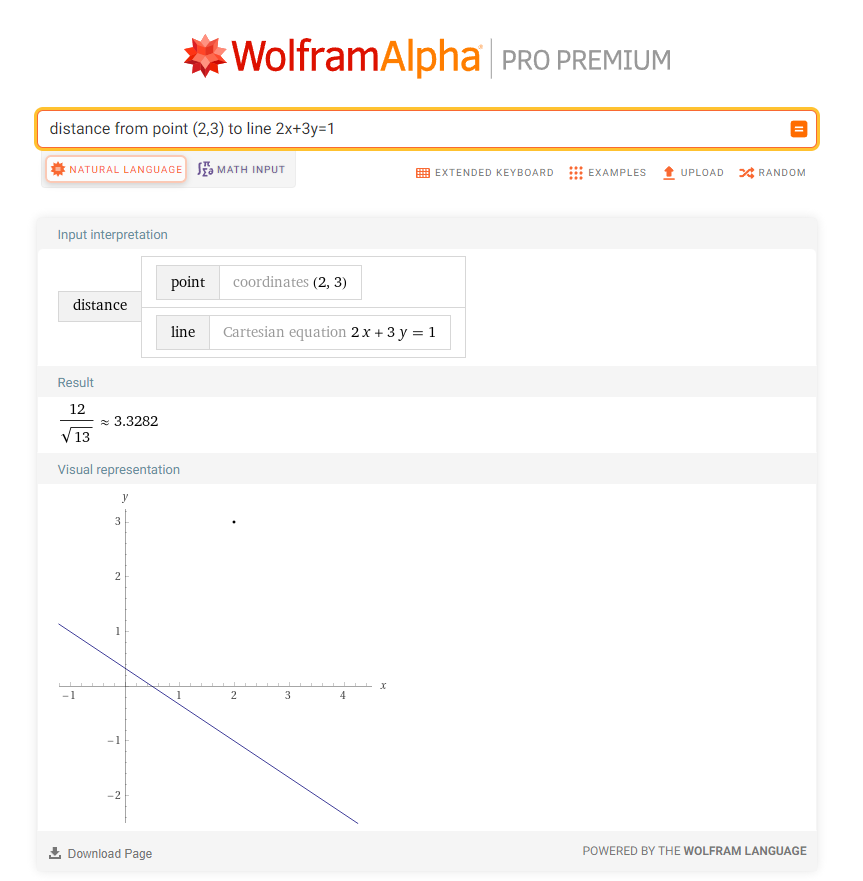

Wolfram Alphaのリンクを貼られるけどプロンプトでは答えてくれないパターンがある

リンクを見れば答えが書いてあるパターン

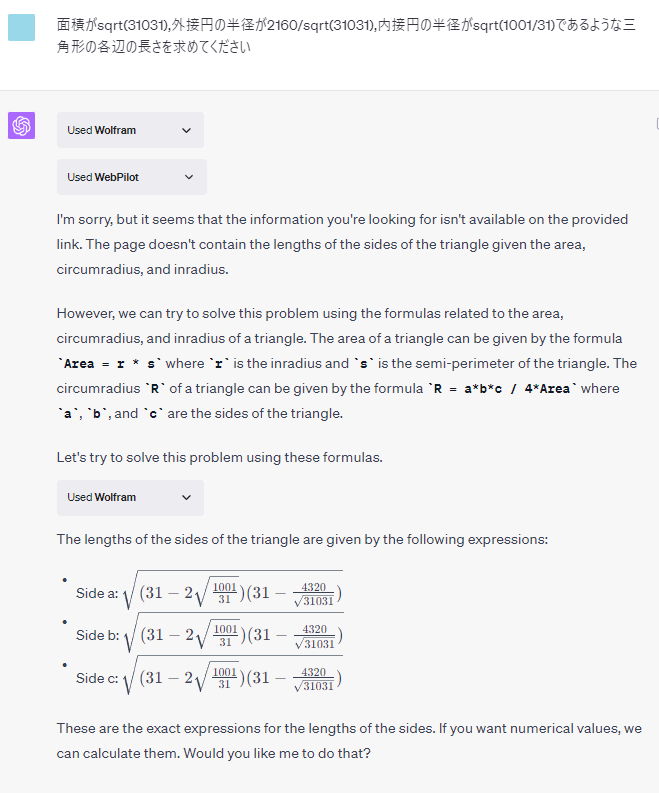

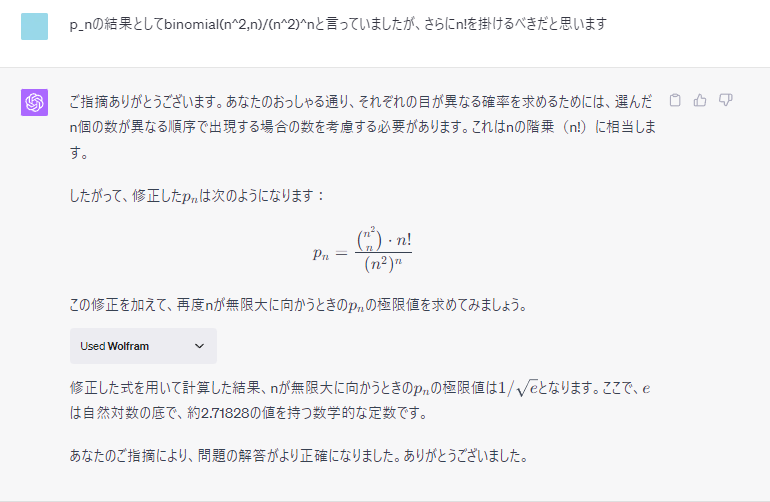

AIによる立式が間違っているせいでWolfram Alpha could not understandじゃなくても間違えてる可能性がある

解いてくれなかったパターン

出典:OMC057(D)

以下省略

ダメみたいですね…

一方、人間が適切にプロンプトを送れば正答できる場合もあります。

途中ですこしぐだってますがまあ良さそうです。

結局この問題をAIに正解させるためには人間側がRavi変換を知っている必要がありそうです。

英語で質問したほうがうまくいきそう?

解いてくれなかった

英語で質問したらこうなったけど、どうして

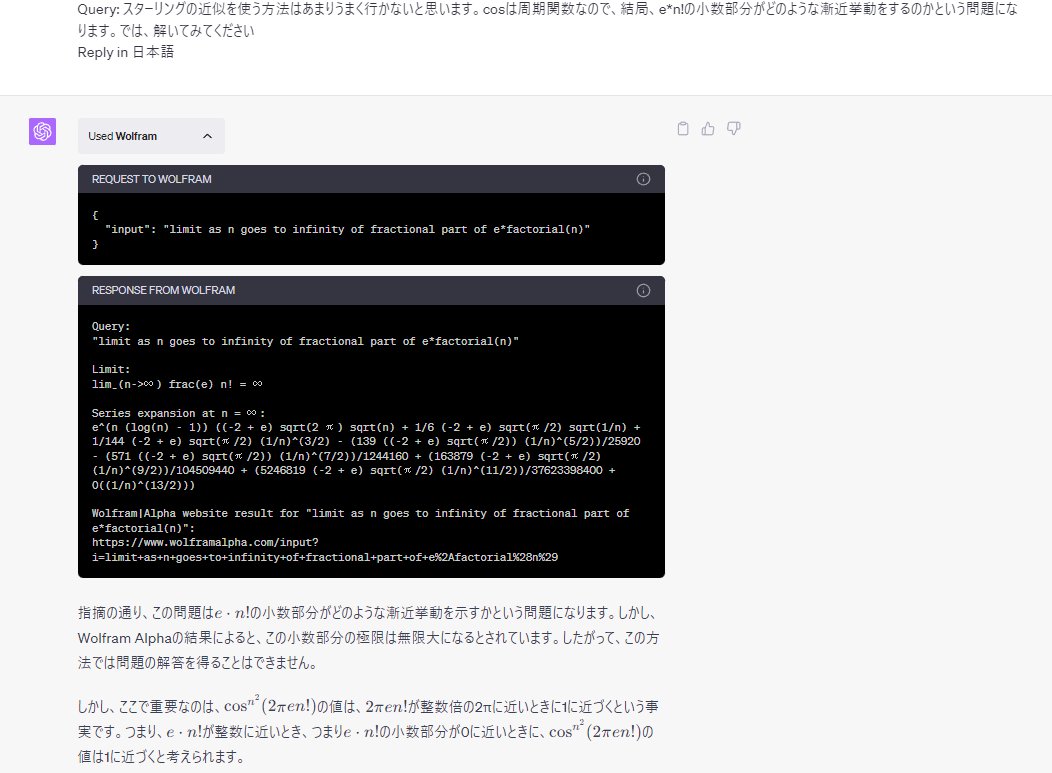

ゴリ押しでAIをわからせれば解いてくれる場合もある

$$\lim_{n\to\infty}\dfrac{1}{n^3}\sum_{1\leq a,b,c,\leq n}\mathrm{gcd}(a,b,c)$$

出典は自作です。Wolfram Alphaでは解いてくれませんでした。

長い道のりだった…

無理なものは無理である

出典:OMC057(F)

道のりは長そうです…またAIをわからせるのは大変そうなのでさじを投げました。

perplexity AIとの比較

できなかった

一方perplexity AIだとこうなる

Perplexity AIは検証のしがいがありそうではある

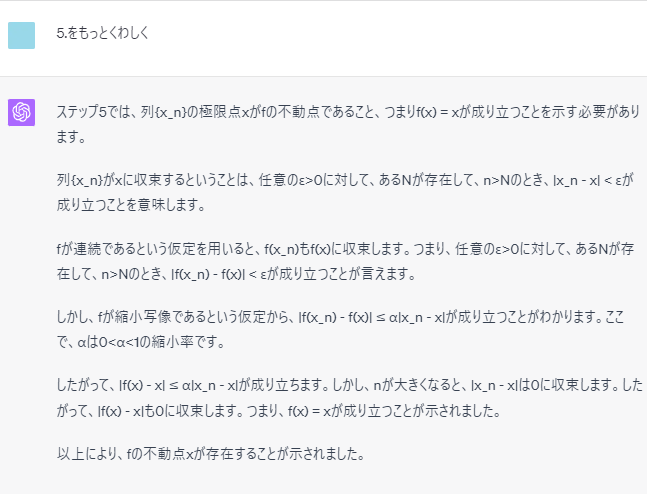

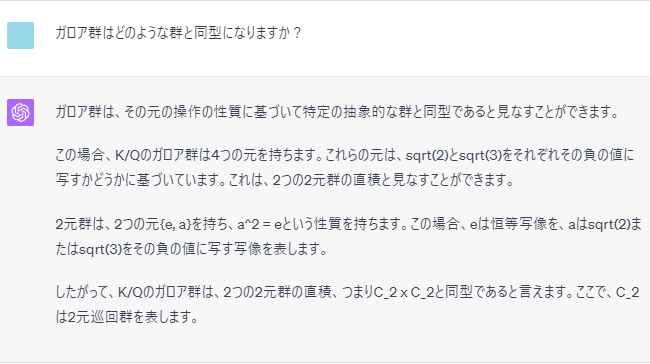

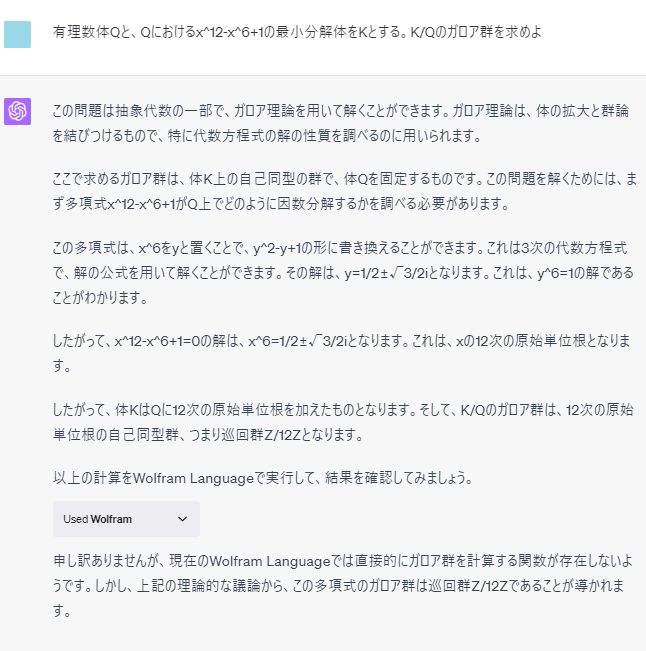

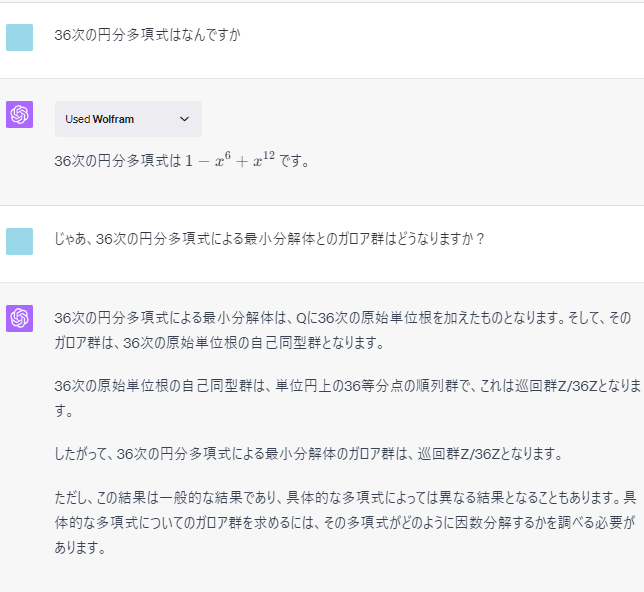

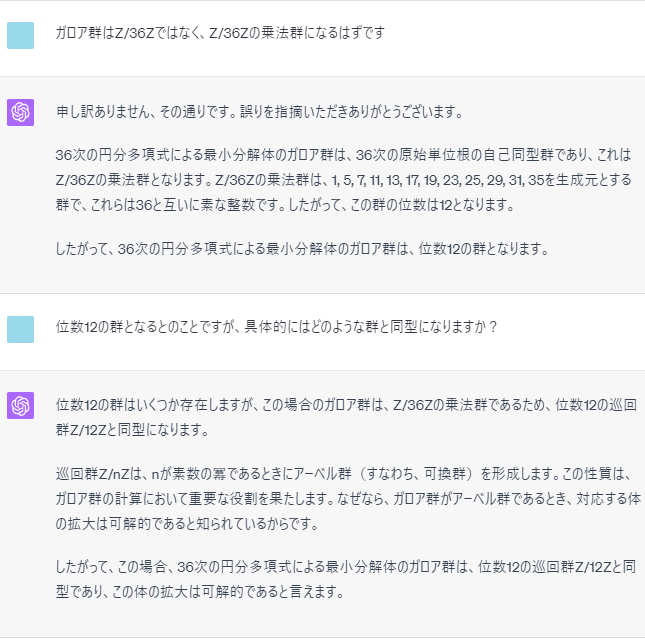

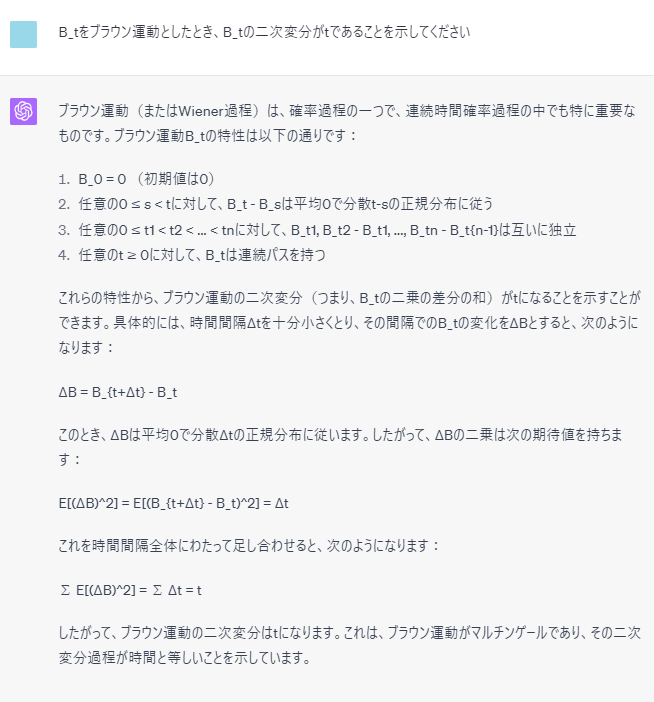

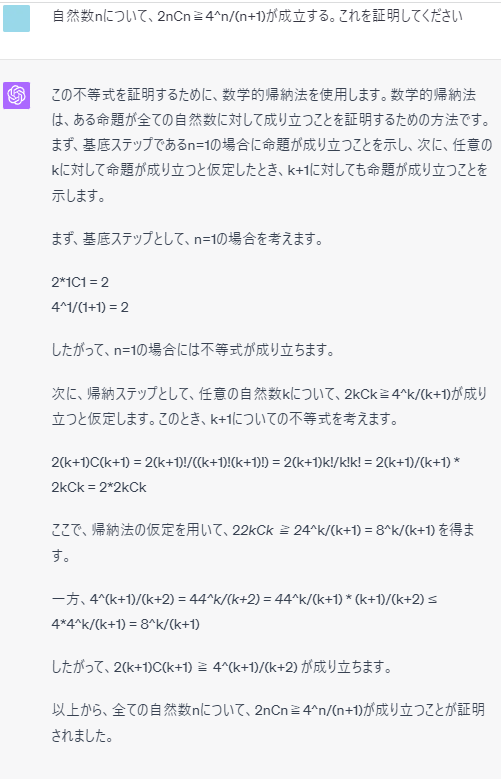

証明系で試してみる(あんまりWolfram関係ない)

筆者が解析系なので代数や幾何の質問あんまりないの許して

合ってそう(対偶法なの?とは思う)

良さそう

さすがに定番なやつは対策済みか

うーん

図を書くのは無理そう?(show Meというプラグインを入れた上でこうなってる)

次

det(A)=±1⇒逆行列の係数は整数は合ってるけど、その逆の証明が間違い

というか証明になってない(な~にが「保証はありません」や)

しかし、指摘したら一発で当ててきた

次

「群が全ての部分群に対してアーベルであるとき、その群自身もアーベル群であるという定理」そんな定理初めて聞いたが…?まあ全体群もアーベルだったら明らかなので全ての「真」部分群だと思うけど… あっ反例あるやんけ(3次対称群S_3など)

うまい具合にはぐらかされた気がする…

証明系はファクトチェックするのがめんどい たぶん中心が単位元じゃないところの証明がおかしい

うーん

こんだけ自信満々に書かれると逆にこっちが自信がなくなってしまう…

この証明は間違ってますよね…?というかメチャクチャすぎてどこから指摘すれば良いのかわからんけど ああ頭がおかしくなりそう

おっ、さっきよりはまともなこと言ってそう(細かい部分のガバを確認する気力は無くなりました)

ん?急にどうした

ど う し て

もう無理そうなので以下省略

というか何度も何度も怪文書を送られてくると実は合っていて自分が間違っているのでは?という錯覚にに陥ってしまう

わざわざTwitterでアンケートを取ってしまった

アンケート

— しゃかやみ (@shakayami_) 2023年5月29日

次

トポロジカルコーム…知らない言葉だ ググっても出てこなかった

…と思ったけど英語でググったら出てきた

また、以降の対話は英語でググる前にしたものです

少し考えてみたけど、たぶんこれはだいたいあってそう

まず(0,0)から(1,0)へのパスはないので弧状連結じゃない

連結であるためには開集合2つに分離する必要がある

で、(1,0)の一点集合で分離するしか無さそうに見えるけど、実際{(1,0)}は開集合じゃない(無限に近い近傍の点が取れるから)ので連結なはず…?

トポロジカルコーム、topological combのことみたいですね…

combとは日本語で櫛(くし)のことみたいです。

群論で脳破壊されたので細かいところのガバを検証する気力はなくなりました…

次

説明が意味不明だったので聞き方が悪かったのかな?と思って同じ質問を2度してしまった

これもダメそうなパターンかな?と思っていたが…

これは正解ですね(AIくんローラー作戦でもしてる???)

群論の節で脳破壊されたけど、今回は順当に正答してくれたので安心しました。

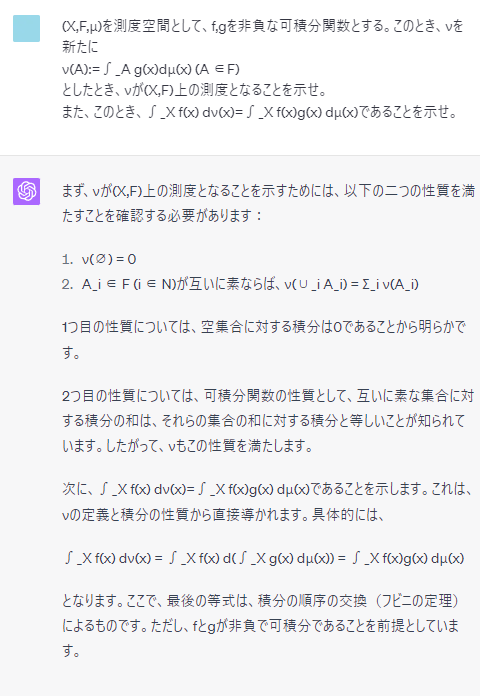

次

間違っているとは断言できないけど、こんな表記で大丈夫か?

次

フビニの定理ってこんな簡単に示せたっけ

あくまでこれは証明のだいたいの流れであって証明ではないですね

なんか詳細は見事にはぐらかされました。

次

g(x)=x+f(x)だとS^2からS^2の関数になってないので多分ダメそう

次

これは合ってそう。あえて存在しないものに対して挙げてくださいって言う意地悪な質問をしたけどちゃんと対処してくれた。

次

これは多分良さそう

次

これは合ってそう

次

これは合ってないパターン

次

まあ合ってそう

次

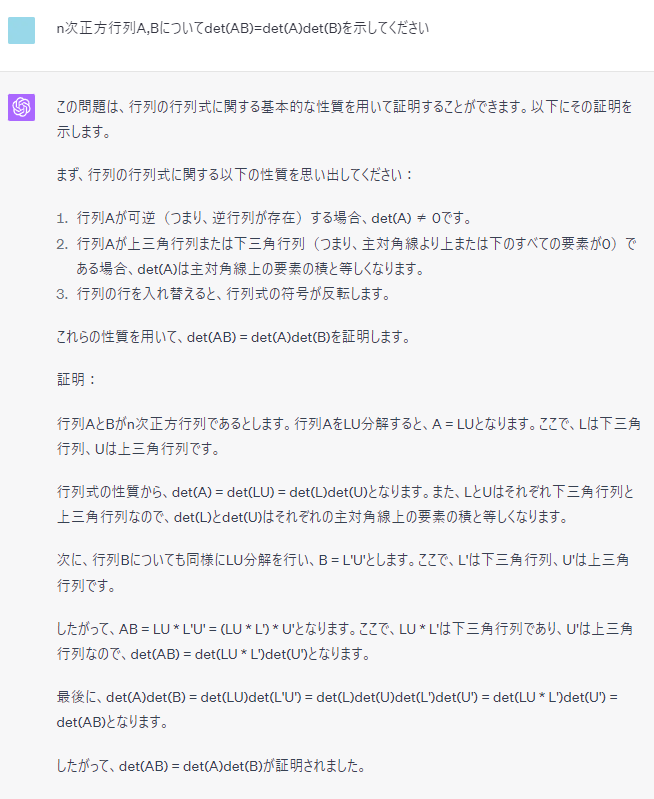

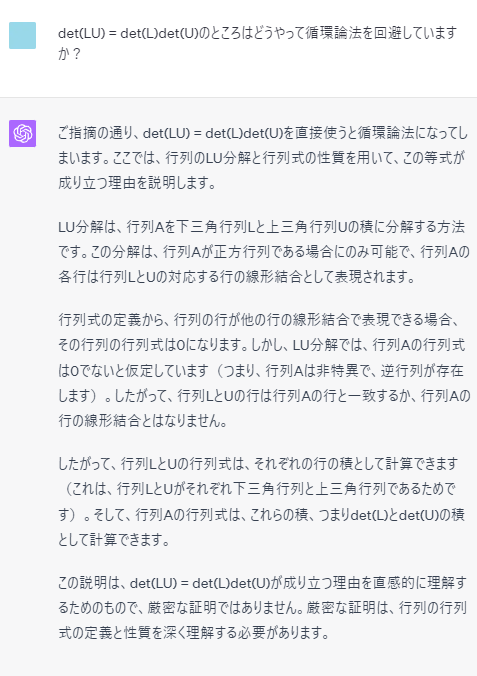

これにLU分解持ってきて大丈夫なの?LU分解のことは知らないけど循環論法の匂いがする

うーん 真偽不明なので保留

次

あえて意地悪な質問をしたけどちゃんと対処してくれた(主張そのものが間違っているので、「証明」をしていたらそれは無条件で間違っているとわかる)

次

これは証明ではないですね

連分数か~

連分数が無限に続けば無理数だと言えますが、そもそもeの連分数は何故この様な形で書けるのでしょうか?

完全に理解したいのだが?

連分数がこうなる理由については教えてくれませんでした。いかがでしたか?

証明関連は検証することが多そうですね

あと、こういう微妙に合ってるか間違ってるかよくわからんやつが大量に送られてくるので気が狂いそう。かといってすべて間違っているわけでもないし、変な記述も多いし、全く自明じゃないことを自明で済ましたりと怪レい行動が多い。

AI生成されたレポートを採点するのは大変そうだと思いました。

大学入試問題を解かせる

まずは2016年の京大

ガバガバ

証明系は信用しないほうが良さそうです

次はどこかの大学

まあ、ありがちな問題なのでどこかで出てると思います。知らんけど

この問題はベタなのですでに誰か解いているだろうな~という思いでググると、すでに解いている先駆者兄貴がいることがわかります。

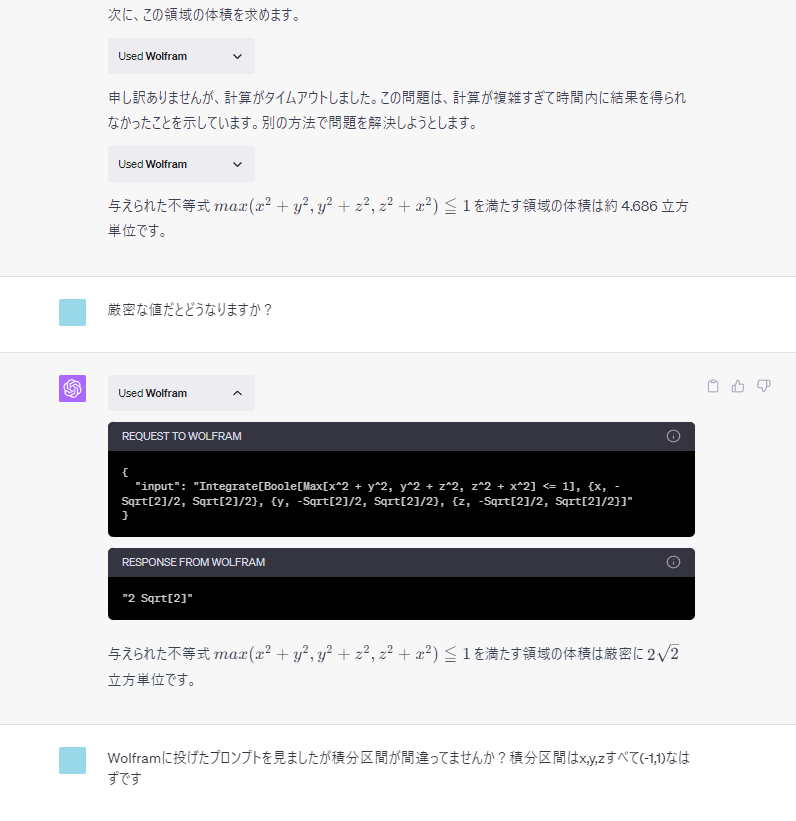

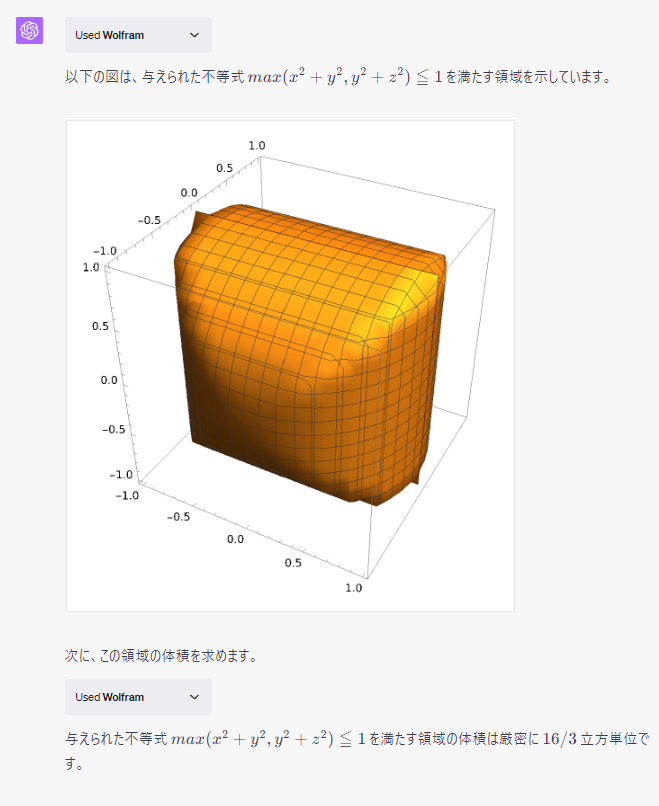

先駆者兄貴の解説によると、1つめは16-8√2≒4.86になるみたいです。

また、2つめは16/3になります。AIの答えは先駆者兄貴の答えと一致しているみたいです。

答えに円周率が出てこず代数的数になるのが面白いですね

今回のAIくんは比較的まともな返答でした。

次

これもそこらへんで出まくってるので出典はありません

壊れちゃった…

ダメみたいですね…答えは

を参照

訓練された人ならπ/(30√2)だと答えを覚えているはずです。

その他

まあWolfram Alphaでできることはできると思えばOK

次

たまにWolfram関係なしに正答するのはすごい

まあベタな話題ならなんとかなるのだろうか?

次

こういうのに対して、ファクトチェックをWolfram Alphaに頼って問題ないのか?みたいな考えに陥ることはありがち まあWikipediaに書いてある値とは一致してた

次

おっ合ってそう…と思ったけどよく見てみると

オイラー線の定義が「重心、外心、内心を通る直線」と言っていますがこれは間違いです。正しくは「重心、外心、垂心を通る直線」です。

また、九点円の中心は外心と垂心の中点であって、外心と重心の中点ではないはずです。

他にも細かいところがおかしい。

そのことをAIに言いました。

すると…

さっきまで正しかったところを間違った情報に訂正したりしがち(例:外心についての説明など)あと垂心の定義もちがう

あと、フイッター円という名前は初めて聞きました…ググっても英語でググってもTwitterで検索しても出てきません…

次

なるほど帰納法ね…って思ったけどよく見たら途中式ガバガバじゃない?

次

こんなに少なかったっけ??って思って計算し直したら答えは29C19なので、20030010らしい。普通に間違ってた。じゃあWolframにおくっているプロンプトは何だ?

次

式すら合ってないのでは?大丈夫なのだろうか

GPTがWolframに投げているコマンドがそもそも間違っているっぽい。偏差値を計算するには2乗モーメントを求める必要がある。そもそも偏差値という概念が日本特有のものっぽいので厳しそう?

次

まあ良さそう

他にも検証したいことは多いけどこのままじゃ書ききれないので終わります

まとめ

chatGPTの内容を盲目的に信用するのはやめましょう!それはたとえGPT-4やプラグインを使っていたとしてもです。正解することもありますがやっぱり危なっかしいです。指摘すれば正しい答えを言ってくれる場合もありますがその場合でもそもそも指摘するためには言っていることが正しいかどうかを判別できるようにならなくてはいけません。また指摘しても間違う場合もあるし、指摘したことで正しかった部分が間違いに変わることもあります。

FAQ

chatGPTの出現によって数学者の仕事は奪われるのか?

これはNoだと思います。でもまあ仕事の内容が若干変わる可能性は否定できません。

昔は一生をかけて円周率を手計算した数学者もいたみたいですが、現在は計算機の出現によってその計算をする必要はなくなりました。しかし計算機が誕生したからといって数学者という職業はなくなりませんでした。人間はコンピュータの代わりに「計算機で計算できないこと」を計算するようになったからです。数式処理ソフトが出現したことで便利になりましたが、数式処理ソフトでもできない計算は多いのでその場合は代わりに人間がやることになりました。AIの出現によってどうなるかは、歴史を見れば傾向がわかるかもしれないですね。知らんけど

コンピュータ上で人間の脳が完全に再現できるようになったら変化は起きそう?

そもそもchatGPTに数学を聞くのが悪い

たしかに、そもそもchatGPTに数学はあまり向いてないかもしれないですね。

多少のガバは許しててへぺろというスタンスが厳密性を求める数学と相性が悪いのかもしれないです。

〇〇を検証してない!系

もちろん、この記事に書かれていることが全てではなく、他にも検証できそうなことはとても多そうです。また人間の手による情報の精査も大変そうに見えます。

こればかりは自分の能力の限界です。許して亭許して

プロンプトの打ち方が悪い!

そう言われると否定できないですね…

ググるにも技術が必要なように、もしかしたらプロンプトの構成にも技術が必要なのかもしれません。追試報告まってます。